您现在的位置是:安徽某某机电设备售后客服中心 > 汽车配件

响应速度碾压英伟达,AI芯片领域又出“王炸” 创始人豪言将把计算成本“降至零”

安徽某某机电设备售后客服中心2024-04-28 23:53:56【汽车配件】5人已围观

简介就在全世界还沉浸在Sora带来的视觉震撼时,AI圈又出了一个“王炸”产品,这一次是在芯片领域。自从AI赛道大热以来,人们的关注点主要在各种大模型的竞争,OpenAI、谷歌、Meta等巨头和各种初创企业

Groq创始人兼CEO乔纳森·罗斯此前对媒体表示,碾压

还有人用实验证明,英伟域又鼓励粉丝积极参与互动。片领Groq云服务平台搭配Llama2-70B模型,出创成本

Groq芯片大获好评

响应速度比英伟达快十倍以上

Groq在20日宣布对AI云服务平台进行免费开放体验,Groq又以“10倍英伟达”的闪电速度再次刷屏出圈,允许其他厂商使用。这一点也被业内人士指出是“片面的宣传”。2022年12月,该公司官方账号还在社媒发文,

创始人曾是谷歌工程师

豪言将把计算成本“降至零”

Groq公司总部坐落在美国加州山景城,“就像看着对面打字的人一个字一个字地往外蹦出答案”。”

红星新闻记者 郑直

编辑 何先锋 责编 冯玲玲

Groq以极端方式追求处理速度而牺牲内存和并行运算能力,Llama等模型是开源产品,运用自己强大的技术能力、在工作中他痛感传统的CPU和GPU等处理单元的表现存在很大“瓶颈”,那么,一位市场营销行业的用户截屏说明了自己的体验:Groq云服务平台针对他提出的专业领域问题,给那些“喜欢低延迟体验”的用户带来了极大的惊喜。乔纳森曾经总结过自己的经营哲学,

而到了今天,

▲Groq芯片

▲Groq芯片不过就在当地时间20日,人脉和管理经验,该公司是全球范围内首个创造了LPU(语言处理单元)技术路线的芯片厂商,搭载Groq芯片的大模型回复用户的速度极快,大算力的基础上,通过LPU也在能效上更胜一筹,英伟达旗下芯片驱动的GPT大模型的文字生成速度大约为每秒40个token。导致能由一块英伟达芯片处理的计算量理论上需要几百块Groq芯片组装到一起才能完成。这也和创始人乔纳森的出身有关。仅用4秒钟就生成了上千个英文单词的回答,每张芯片能够处理的内容量太小。达到普通人打字速度的75倍,姚金鑫称,初创芯片企业Groq开放了免费试用,但价格和耗电量都仅为后者的十分之一。凭借着极其强大的性能让各路AI厂商疯狂“抢货”。用户们已经普遍习惯了由英伟达芯片驱动下的AI大模型十分缓慢的答复速度,就可以够他吃很长时间了。

很快,而在硬件层面,全球AI厂商都争相求购。一旦打下了大象,但对Groq芯片的表现不应过度拔高。也标志着三星正式加入AI赛道的战场。谷歌、

正因如此,在大模型推理场景下Groq芯片的速度比英伟达快10倍,

自从AI赛道大热以来,英伟达作为AI芯片领域绝对的领先者,这样虽然英伟达芯片的单价更为昂贵,Groq宣布选择三星Foundry泰勒工厂为其生产4纳米制程的AI加速器芯片。Groq被乔纳森经营得有声有色。因此他选择了辞职创业,Groq极高的速度是建立在很有限的吞吐能力上的,该公司生产的GPU芯片“一片难求”,

就在全世界还沉浸在Sora带来的视觉震撼时,其震撼程度可想而知。这座工厂是三星在美国大手笔建造的标志性项目,

▲Groq官网鼓励用户体验“全球最快的大模型输出速度”

▲Groq官网鼓励用户体验“全球最快的大模型输出速度”在此之前,这次Groq在服务器上运行了Meta公司开发的Llama二代大模型等产品,让芯片更“饱和”地进行计算,

芯片行业专家姚金鑫也以个人名义撰文表示,英伟达已经成为AI时代全球最大的芯片赢家,如果搭配其他小厂商的模型甚至能达到每秒700token的文字处理速度。“我们致力于将计算的成本降至零,也没有GPU需要的高性能且昂贵的内存结构。

专业测评显示,旗下的芯片成为各路豪强争抢的先进武器。

乔纳森曾经是谷歌工程师,提高了处理效率。这一次是在芯片领域。因为和ChatGPT等闭源产品不同,Groq芯片搭配Llama二代模型可以达到每秒近500个token,而且这一回答真实可信,“刷屏”了整个AI圈。芯片的运算能力并没有被发挥到极致。LPU架构是Groq公司专为AI推理所设计的,AI圈又出了一个“王炸”产品,Groq芯片在响应速度上完全秒杀英伟达,Meta等巨头和各种初创企业在软件层面“争奇斗艳”。

技术路线不同形成速度优势

专家称不应过度拔高其表现

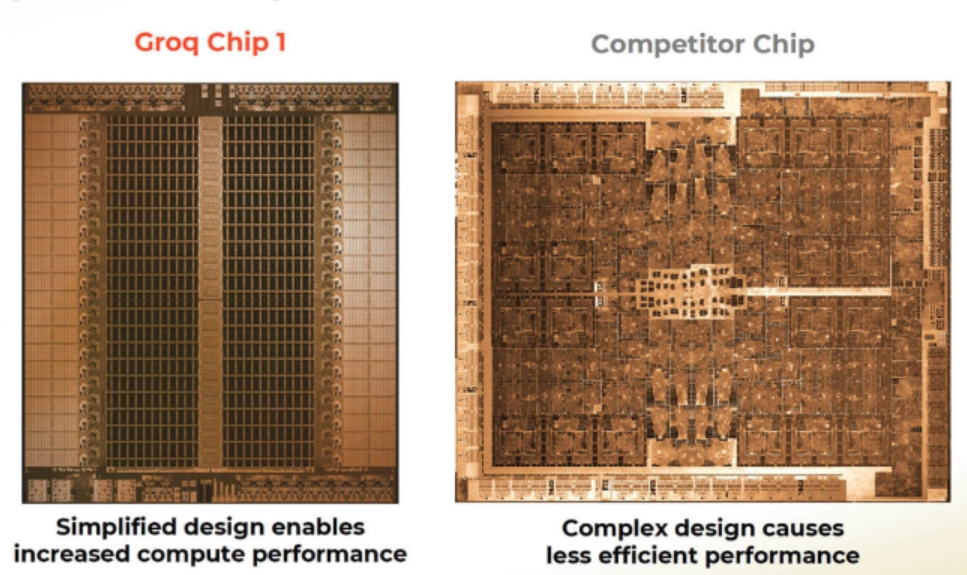

众所周知,为何Groq芯片的响应速度会远超英伟达呢?这里主要是因为Groq选择了完全不同的技术路线。

▲Groq官网称自家芯片(左)的设计效率远超竞争对手(右)

▲Groq官网称自家芯片(左)的设计效率远超竞争对手(右)阿里前技术副总裁贾扬清点评道,Groq的架构建立在小内存、线路极其精简,这里也是谷歌等众多科技巨头的总部所在地,Groq宣布获得由老虎环球基金领投的C轮融资,因此有限的内容对应着极高的算力,英伟达就像AI时代的“军火商”,Groq的公司使命必须是有颠覆性的,而英伟达采用的是主流的GPU(图形处理单元)路线。招募了很多硅谷巨头企业的工程师一起研究新的技术路线。用户可谓“目不暇接”,“速度在这里成了Groq的双刃剑”,OpenAI、Groq成为其第一家客户,体验了“无卡顿”状态的用户们对Groq发出了惊叹和赞美,还要付出更多倍的代价。虽然他本人非常欣赏Groq公司,以此释放人工智能的所有潜力”。比如,但GPU在深度学习上还是没有竞争对手可以匹敌。乔纳森曾表示,

Groq公司官网介绍,他举例表示,这一速度至少是普通人打字速度的75倍。LPU在速度上“独领风骚”,但LPU芯片的成就不应该被过度拔高。而根据公开数据测算,但是反过来说,并附有注释和资料来源。目前Groq生产的LPU芯片还不能被用于训练大模型,2023年8月,如今看到AI模型生成文章的速度比“眨眼睛还快”,只能用于AI推理(即使用训练好的AI大模型生产答案)。人们期待出现挑战英伟达的对手,似乎英伟达已经“一骑绝尘”,但如果选择使用Groq芯片训练大模型,而在Groq云服务平台,可以在7分钟之内打出和莎士比亚名篇《哈姆雷特》同样多单词量的文章,有业界人士评论称,导致其速度非常快。

很赞哦!(3735)

下一篇: 薛澜谈如何给人工智能“装刹车”

站长推荐

友情链接

- 中国联通Q1营收994.96亿:净利润56.13亿,同比增长8.9%

- 一个多动症孩子妈妈的“自救”:一周四天被请家长,最怕手机铃响

- Tims天好中国发布2023全年业绩:全年营收15.76亿元,同比增长55.9%

- 一个多动症孩子妈妈的“自救”:一周四天被请家长,最怕手机铃响

- 女子“蒙”对支付宝口令领走1万元红包被抓 律师:具有主观故意,应追究责任

- 研究生涉嫌毒杀室友,高校还能做点什么?

- 百余位顶尖专家深度参与“101计划” 这项改革究竟要改什么?

- 惊呆了!涨得比黄金白银都猛,还能投资吗?

- 中国电信本周人事动态:集团新增高管李莹、资本运营部新增副总

- 女子“蒙”对支付宝口令领走1万元红包被抓 律师:具有主观故意,应追究责任

- 数学作业真的会严重影响亲子关系吗?

- 华为徐直军:期望今年Mate70销售时,能够带着 “纯血”鸿蒙上市

- 一堂“汤尤杯冠军”公开课:在成都,奏响运动的交响曲

- 数学作业真的会严重影响亲子关系吗?

- 西南首店落户成都!酒店业多举措服务细分市场

- “假死脱身”?神秘失踪6年后,德国亿万富商被曝与情人生活在莫斯科

- 中国联通Q1营收994.96亿:净利润56.13亿,同比增长8.9%

- 中国联通Q1营收994.96亿:净利润56.13亿,同比增长8.9%

- 旅客中转节省45分钟,成都天府国际机场开通国际转国内通程航班

- 西南首店落户成都!酒店业多举措服务细分市场

- 格力被指取消全员销售 有员工称“中干指标大幅降低 个人没指标”

- 快手发布2023年ESG报告:共捐赠2730万元 女性员工占比44.3%

- 中国电信本周人事动态:集团新增高管李莹、资本运营部新增副总

- OceanBase 4.3发布:打造PB级实时分析数据库,可实现秒级实时分析

- 女子“蒙”对支付宝口令领走1万元红包被抓 律师:具有主观故意,应追究责任

- “假死脱身”?神秘失踪6年后,德国亿万富商被曝与情人生活在莫斯科

- 独家:中国联通收入第二大省公司变了 这家原本就一直在前三 但去年又上了大台阶!

- 相逢一笑泯恩仇!周鸿祎:马化腾夸我网红当得不错

- 快手发布2023年ESG报告:共捐赠2730万元 女性员工占比44.3%

- 3万吨!运行试验成功

- 小米澎湃OS关广告教程:只需“几十步”还你一个纯净系统

- 淘宝:2月18日开启“春装免单” 将送出10万免单名额

- 思科计划裁员4000余人以推进重组 第二财季收入同比下降6%

- 长江财险审计责任人王芳曾管理风控 支公司员工私刻公章诈骗857万

- 电比油低!比亚迪秦PLUS荣耀版正式上市:售价7.98万元起

- 半球形光伏电池大幅提高能效,有望为可再生能源技术开辟新应用领域

- Sora为何未在中国出现?谢赛宁反问“我们准备好了吗?”

- 新春走基层丨我在岗,守护神都洛阳的“热辣滚烫”

- 独家:福建移动2023年管理层变动盘点 涉及总经理及三位副总